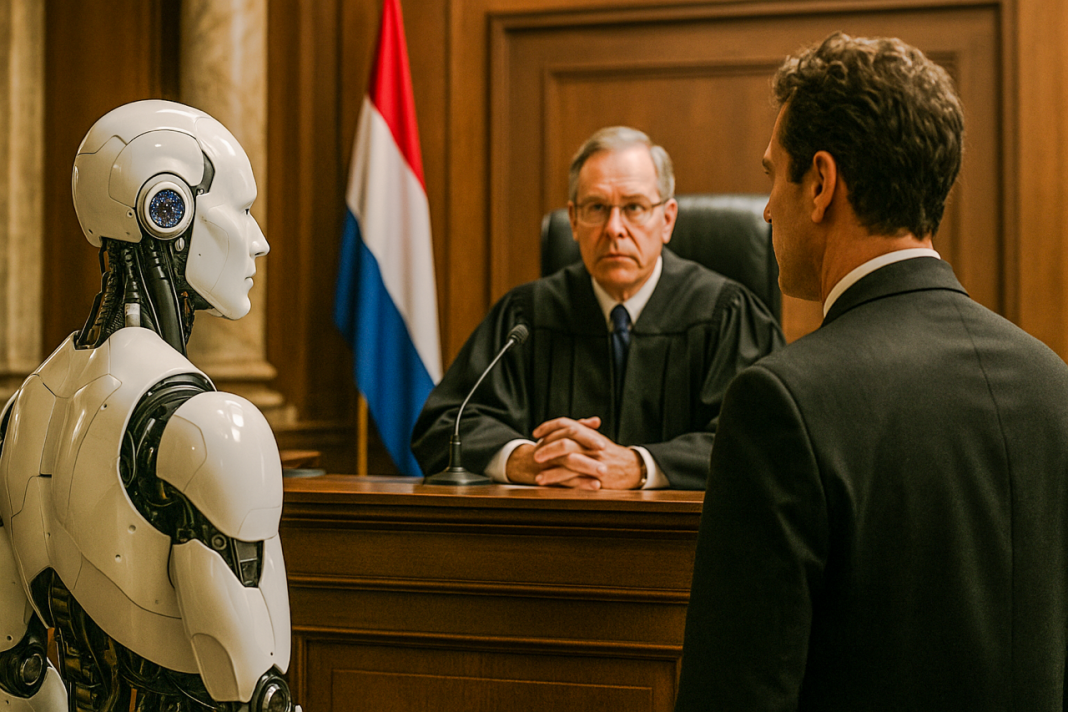

1. AI als gamechanger in de juridische praktijk

AI-systemen zoals GPT-4, Harvey, CoCounsel, Hebbia of CaseMark worden steeds vaker ingezet om documenten te analyseren, juridische clauses te evalueren, dossiers te structureren en zelfs conceptadviezen op te stellen. Nederlandse kantoren gebruiken tools als LegalMike, LEXGEN of Lexboost om efficiënter te opereren en cliënten sneller en betaalbaar te bedienen.

In-house juristen klikken recentelijk duidelijke transparantie: zij willen precies weten wanneer AI wordt gebruikt en hoe dat impact heeft op hun zaak.

2. AI is geen vervanging – maar wel kritieke ondersteuning

Een Harvard/ABA-analyse suggereert dat advocaten mogelijk zelfs verplicht zijn om AI te gebruiken om redelijke en tijdige dienstverlening te bieden; het niet gebruiken kan beroepsregels schenden zoals redelijkheid van kosten (Rule 1.5) of voortvarendheid (Rule 1.3).

Rechters en verzekeringsexperts waarschuwen voor risico’s van AI-gebruik zonder controle, zoals vertrouwelijkheidsschendingen, hallucinerende citaten of verkeerde formuleringen; toezicht en verificatie blijven cruciaal.

Een voorbeeld: in de VS stonden advocaten van Butler Snow terecht omdat zij valse jurisprudentie gebruikten die volledig door AI was gegenereerd en nooit gecontroleerd werd de rechtbank diskwalificeerde hen van de zaak en meldde de situatie aan de Orde in Alabama.

3. Nederlandse context: regels, toezicht en AI-integratie

De Nederlandse Orde van Advocaten erkent de voordelen van AI voor het ontwerpen van concepten, documentanalyse en workflow-efficiëntie, maar benadrukt ook dat advocaten te allen tijde verantwoordelijk moeten blijven voor juridisch-inhoudelijke beslissingen.

Volgens de Advocatenwet mogen enkel geregistreerde advocaten wettelijke adviesfunctie uitvoeren, en een ‘AI-kantoor zonder advocaten’ kan binnen deze kaders niet legaal opereren zonder menselijke verantwoording.

4. Empirisch bewijs: AI kan overtuigend, maar niet altijd adequaat

In een experimentele steekproef met Nederlandse juristen beoordeelde 80% van de deelnemers de AI-gegenereerde juridische tekst als overtuigender dan die van een menselijke advocaat bij een casusstudie, maar de nadruk bleef liggen op de noodzaak van kwaliteitscontrole door gekwalificeerde juristen.

Internationale studies tonen dat AI vaak overtuigend taalgebruik produceert, maar gebrek aan diepgaande redenering, causaliteit en juridische sensitiviteit vertoont: een potentieel risico voor rechtsgeldigheid of nuance.

5. Directeur AI-bedrijf Robin AI: AI verandert, maar human oversight blijft essentieel

Richard Robinson (Robin AI) adviseert dat AI correctief gebruikt moet worden: het moet op betrouwbare juridische data gebaseerd zijn, met volledige transparantie van bronnen, en mét menselijke verificatie om ‘hallucinaties’ te voorkomen. AI optimaliseert, maar vervangt nooit de menselijke rechtsbedeling of verantwoordelijkheid.

Samenvattende conclusie:

Advocaten staan niet boven, maar naast AI. AI is geen magisch vervangingsinstrument, maar een geavanceerde assistent die repetitieve en analytische taken versnelt.

Verantwoordelijkheid en ethiek liggen bij de advocaat, niet bij de technologie. Alleen menselijke juristen zijn bevoegd, ethisch geëquipeerd en aansprakelijk.

AI-interventie zonder controle is inadmissible risicovol. Voorbeelden in de VS tonen dat rechtelijke sancties kunnen volgen bij foutieve AI-gebruik in processtukken.

Toekomstvisie: In Nederland is het realistisch dat AI binnen korte tijd een volwaardig partner wordt in de praktijkvoering—mits met transparantie, kwaliteitscontrole en juridische supervisie.

Advocaten zijn niet boven AI, maar ze leiden het gebruik ervan: AI draagt bij, maar uiteindelijk bepaalt de advocaat de richting, de inhoud én de aansprakelijkheid. Willen we AI inzetten? Zeker. Maar zonder menselijke integriteit, oordeel en verantwoordelijkheid blijft het slechts een hulpmiddel.